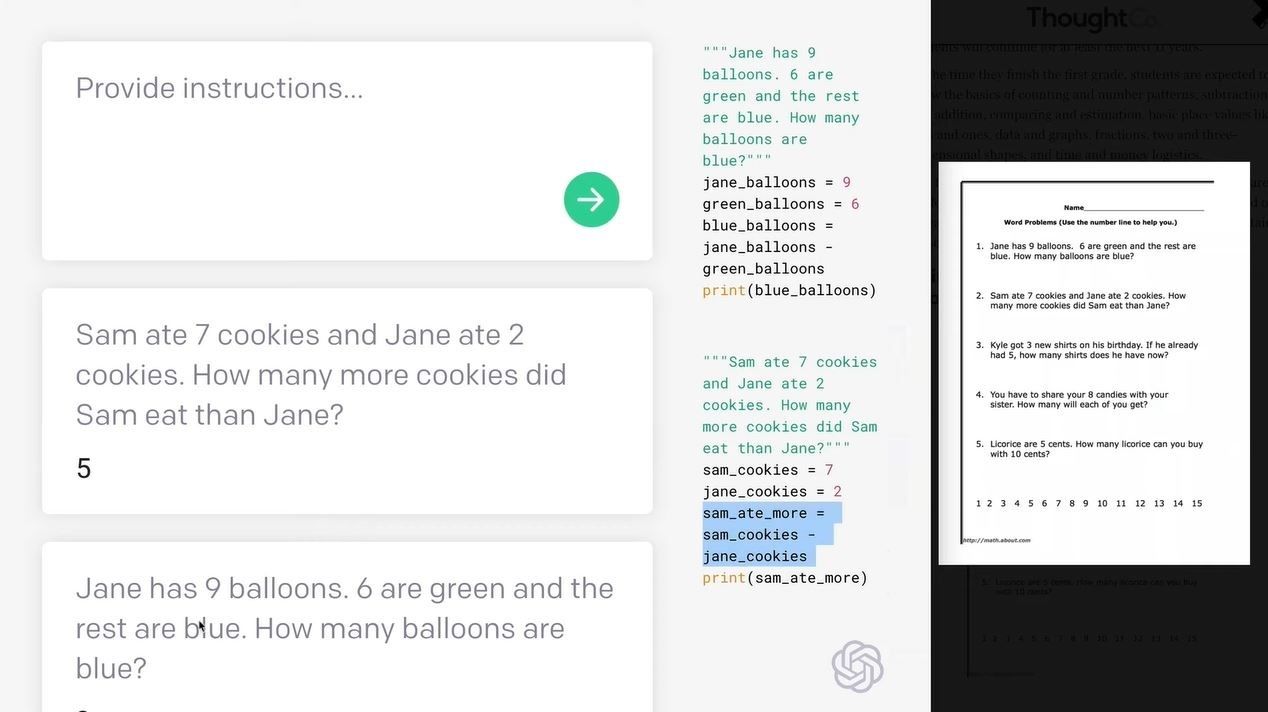

Creada por la empresa OpenAI, ChatGPT es una tecnología de aprendizaje automático que está diseñada para realizar tareas relacionadas con el lenguaje, desde la traducción hasta la generación de texto. A su vez, se especializa en el diálogo, por lo que es posible pedirle información sobre prácticamente cualquier tema, que será respondida con una naturalidad tal que parecerá escrita por un ser humano. También puede mantener conversaciones, inventar historias, escribir poemas, contenidos de todo tipo y hasta crear códigos de programación, incluidos los maliciosos, y mucho, mucho más.

En foros de la dark web, hackers han explicado que utilizaron esta herramienta para generar textos de phishing o para crear malware, en especial piratas sin demasiado conocimiento informático que pudieron crear contenido malicioso gracias a la ayuda de ChatGPT.

“No tengo dudas de que ChatGPT y otras herramientas como esta democratizarán el ciberdelito”, dijo Suleyman Ozarslan, investigador de seguridad y cofundador de Picus Security, en diálogo con el sitio Techcrunch. “Ya es bastante malo que el código de ransomware esté disponible para que la gente lo compre 'listo para usar' en la dark web. Ahora prácticamente cualquiera puede crearlo por sí mismo”.

Por su parte, Laura Kankaala, líder de inteligencia de amenazas de F-Secure consultada por TechCrunch, puso en duda la confiabilidad del código generado por esta IA: “debe tenerse en cuenta que puede ser peligroso confiar plenamente en la salida de texto y código generado por ChatGPT: el código que genera podría tener problemas de seguridad o vulnerabilidades. El texto generado también podría tener errores fácticos absolutos”.

Con una mirada más optimista, Jake Moore de ESET cree que “si ChatGPT aprende lo suficiente de sus aportes, pronto podrá analizar posibles ataques sobre la marcha y crear sugerencias positivas para mejorar la seguridad”.

Es que ChatGPT, es un sistema de chat basado en el modelo de lenguaje por Inteligencia Artificial GPT-3, que a su vez utiliza un algoritmo de Deep learning que ha sido “entrenado” con más de 175.000 millones de parámetros, y se ha alimentado con todos los libros públicos disponibles en internet, todo el material disponible en Wikipedia y millones de páginas webs y papers científicos.

¿ChatGPT Pro?

Debido al gran éxito que ha tenido desde su reciente lanzamiento, y la sobrecarga de su demanda, desde Open AI, está proyectando la versión de pago de ChatGPT, según anuncia LaSexta.

Se denominará ChatGPT Professional, y se espera entonces que este servicio deje de ser totalmente gratuito, como lo es hasta ahora. De hecho, en los últimos días no ha sido posible utilizar la herramienta si no se posee una cuenta creada previamente en la plataforma.

Los especialistas estiman que la versión profesional del chatbot tendrá mayor rendimiento y capacidad, más acorde a las necesidades de una empresa u organización. ¿Significará esto un peligro para los profesionales que ven sus tareas “imitadas a la perfección” por esta herramienta?

Desde eleconomista.es le consultaron al mismo ChatGPT si “su uso puede reducir el número de profesores, periodistas o programadores”. La herramienta de IA respondió: “no creo que mi uso pueda reducir el número de profesores, periodistas o programadores. Mi uso como inteligencia artificial está diseñado para complementar el trabajo de estos profesionales, no para reemplazarlos. Puedo ayudar a los profesores a preparar material didáctico, a los periodistas a recopilar y organizar información, y a los programadores a realizar tareas específicas. Sin embargo, no tengo la capacidad para reemplazar la creatividad, el juicio y la empatía que estos profesionales aportan a sus respectivos campos”.

Los primeros centros educativos en alerta por ChatGPT

En Nueva York, el departamento de educación ha restringido el uso de este chatbot en las escuelas públicas debido a “impactos negativos en el aprendizaje de los estudiantes y preocupaciones con respecto a la seguridad y precisión del contenido”, ya que las devoluciones de la herramienta no siempre son objetivamente correctas y, a veces, son también ofensivas.

Al mismo tiempo, y en respuesta a esta situación que se presentó en el ámbito educativo, desde Open AI, un portavoz le dijo a TechCrunch que la compañía está desarrollando "mitigaciones" para ayudar a cualquier persona a detectar el texto generado por ChatGPT.

Otros avances de IA que alertan a profesionales

Alejandro Graue, actor de doblaje argentino, publicó en su cuenta de Twitter hace pocos días que fue reemplazado en un trabajo por una herramienta de generación de voz artificial.

“Era un canal de YouTube en inglés que comenzó a doblar su contenido al español neutro, de Latinoamérica. El proyecto estaba yendo muy bien, pero vi que subieron un vídeo nuevo y me extrañó porque yo no había doblado nada. Cuando entré a escucharlo, me di cuenta de que estaba doblado con una Inteligencia Artificial", le explicó Graue a 20minutos.es.

Yyyyyy llegó el día: me reemplazaron en un trabajo con voz generada por Inteligencia Artificial. Gracias a tod@s l@s actores y actrices que dan sus voces para crear esta mierda que eventualmente nos dejará obsoletos a todos. Los artificialmente inteligentes son ustedes.

— Ale Graue (@Alegraue) January 10, 2023

Por su parte, Apple ha lanzado una nueva función en su aplicación de libros, que ahora son narrados por voces artificiales. Hasta el momento, los audiolibros eran grabados por locutores y actores de voz, que podrían ver mermar sus fuentes de trabajo.